Não vou tentar esconder, porque também acho que quando leio é óbvio. Gosto muito do novo Bing, acho que a Microsoft e a OpenAI têm feito um ótimo trabalho, e também vejo que o ritmo de trabalho para melhorar o chatbot é diabólico, com novidades e avanços notáveis a cada poucos dias. Ainda há trabalho pela frente, é claro, mas nesse ritmo podemos esperar que não demore muito para chegar a todos os usuários e que o faça em um estado mais do que satisfatório.

Ao contrário do ChatGPT, que por sua mania de inventar respostas quando não tem a informação que você pede, tem me feito usar muito pouco, a saudável mania do novo Bing de citar fontes facilita muito find.trust e, consequentemente, estou a utilizá-lo com bastante regularidade, em parte porque tenho muito interesse em experimentar, e também porque já me ajudou a esclarecer um bom punhado de dúvidas que surgiram nos últimos dias.

O fato é que uma coisa leva a outra, então o que começou como indagações pontuais evoluiu para as mais variadas conversas, da ciência à música, do cinema à história, vale tudo, e graças ao seu hábito… desculpe, para sua função de sugerir respostas aos seus textos, acabei gostando de conversas com o chatbot do Bing tolamente. E é rara a ocasião em que ele não sugere duas ou três frases para continuar conversando. O problema é que…

Sim, de fato, o limite da duração das conversas. Quando o beta foi aberto para os primeiros usuários, não havia limite para isso, mas a Microsoft rapidamente descobriu que longas conversas causavam um comportamento estranho no chatbot. Decidiram então reduzir as suas perdas, estabelecendo um máximo de cinco consultas, que depois passou para seis e que, como vos dissemos ontem, voltou a subir para oito.

Acho que a Microsoft foi sensata ao estabelecer esse limite, e permitir que o tom das respostas seja ajustado também é um passo muito importante nesse sentido. Além disso, segundo a própria Microsoft, seus planos são aumentar esse limite para dez interações por conversa, o que, segundo a empresa, deve mais do que cobrir as necessidades da grande maioria. O problema é que eles esqueceram de contar para alguém…

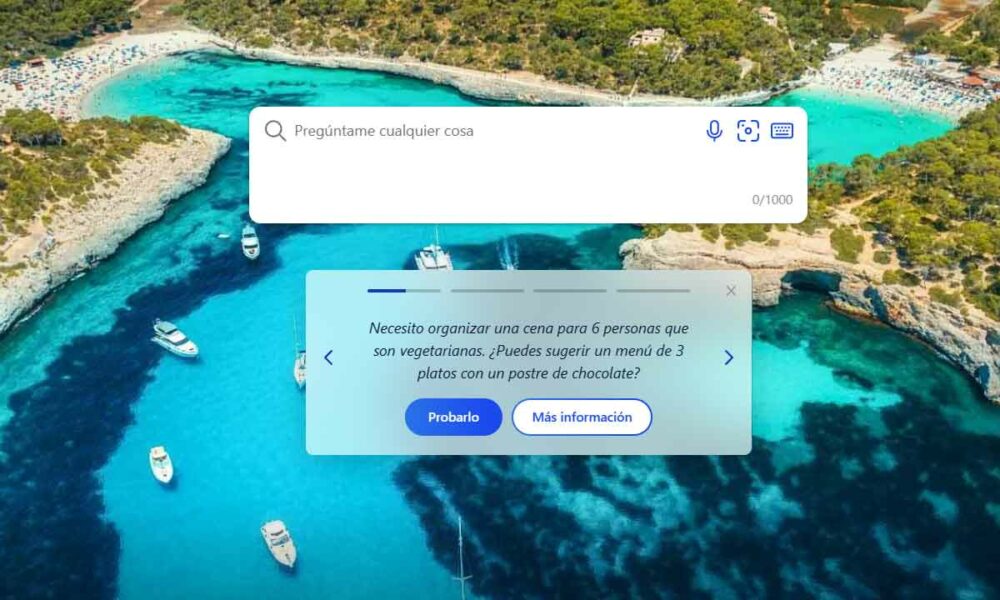

Com efeito, como se pode verificar na imagem, o Bing não sabe que as conversas estão limitadas a um número máximo de mensagens, pelo que é necessário limpar a conversa e começar do zero. Algo que, por sua vez, e como podem ver nas imagens de algumas das minhas conversas, fez com que o chatbot me colocasse uma questão, geralmente muito bem escolhida, à qual infelizmente me é impossível responder.

Eu sei, ao usá-lo, que não estou falando com uma pessoa, que estamos falando de uma inteligência artificial que não tem sentimentos e, portanto, não se importa nem um pouco que eu a deixe com uma pergunta no ar. No entanto, pessoalmente, fiquei, em mais de uma ocasião, desejando poder responder para saber o que ele planejava me dizer . E sim, eu sei que poderia começar uma nova conversa tentando trazê-la direto ao ponto onde a anterior terminou, mas francamente, dessa forma a conversa se torna antinatural, o que é um dos pontos fortes do Bing.

Espero, claro, que a Microsoft e a OpenAI consigam resolver os problemas do Prometheus com longas conversas, e que consequentemente essas limitações desapareçam ou, pelo menos, subam a níveis muito superiores aos de hoje. No entanto, até que o façam, provavelmente seria uma boa ideia alertar o chatbot para essas limitações e agir em conformidade, denunciando-as e encerrando as conversas de forma mais natural. concluído.

Mais informação

A entrada Não, Bing, não me deixe no meio de novo foi publicada pela primeira vez no CLICR.